(通讯员:刘瑾)近期,在西电2026年国际足联世界杯马建峰教授指导下,习宁教授团队围绕“大模型与联邦学习隐私保护”方向的系列研究成果“Rethinking LoRA for Privacy-Preserving Federated Learning in Large Models”和“DP-FedAdamW: An Efficient Optimizer for Differentially Private Federated Large Models”分别被ICLR 2026和CVPR 2026收录。两篇论文的第一作者均为网络安全与密码学部习宁教授和苗银宾教授共同指导的2023级博士生刘瑾,天津大学的博士生刘俊康为论文的合作者。

ICLR 2026的全称是The Fourteenth International Conference on Learning Representations,将于2026年4月23至27日在巴西里约热内卢召开。该会议是公认的当前最具影响力的深度学习领域国际顶级会议之一。CVPR 2026的全称是The IEEE/CVF Conference on Computer Vision and Pattern Recognition 2026,将于6月3日至7日在美国丹佛召开。该会议是国际公认的计算机视觉领域顶级国际会议之一。ICLR与CVPR被中国计算机学会(CCF)列为A类会议,其收录的论文代表了该领域最前沿的研究成果。

在联邦大模型差分隐私微调领域中,低秩适配(LoRA)已成为实现大模型高效微调的重要方法,该方法通过在骨干网络上引入低秩矩阵,有效降低了训练成本并提升了微调性能。然而,实践表明,传统LoRA在 差分隐私联邦学习(DPFL)中性能仍不理想。为深入理解其性能退化的原因,我们首次系统分析了三大关键问题:一是 梯度耦合导致局部更新之间存在严重干扰;二是差分隐私噪声在低秩矩阵更新中被结构性放大;三是全局聚合易落入尖锐极小值区域,限制了模型的泛化能力。

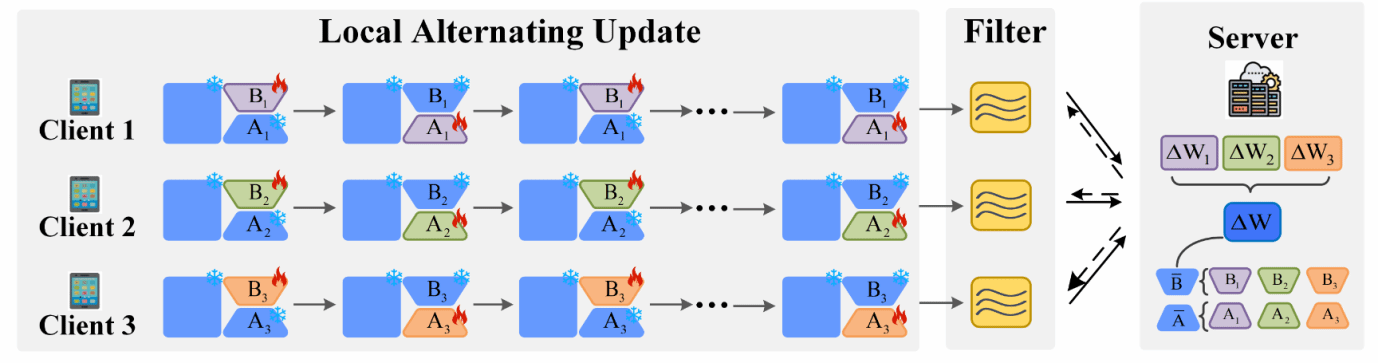

针对上述问题,我们提出了LA-LoRA框架:在每轮本地迭代中采用局部交替更新以解耦梯度干扰并抑制DP噪声放大,同时缓解全局聚合尖锐性,改善泛化能力;并可选引入高斯低通滤波平滑矩阵梯度中的高频噪声。理论分析表明,局部交替更新保证了低秩优化的稳定性和唯一闭式解。为验证方法有效性,论文在视觉和语言任务上进行了大规模实验。结果显示LA-LoRA 在严格DP约束下显著优于SOTA方法。该工作已被ICLR 2026收录。

LA-LoRA架构示意图

在联邦大模型自适应优化领域中,AdamW是大模型训练和微调的主流方法,它通过对每个参数的梯度历史进行自适应步长调整,实现收敛加速。然而,直接将AdamW应用于DPFL存在显著性能瓶颈。我们首次发现,在DPFL中,AdamW的性能受三方面因素制约:一是二阶矩方差放大,非IID客户端数据和DP噪声共同导致AdamW的二阶矩估计方差膨胀,进而使自适应步长不稳定;二是二阶矩估计偏置,梯度裁剪与DP噪声注入会引入系统性偏差;三是客户端漂移加剧,在非IID数据和DP约束下,本地AdamW容易局部过拟合,导致客户端参数偏离全局最优。

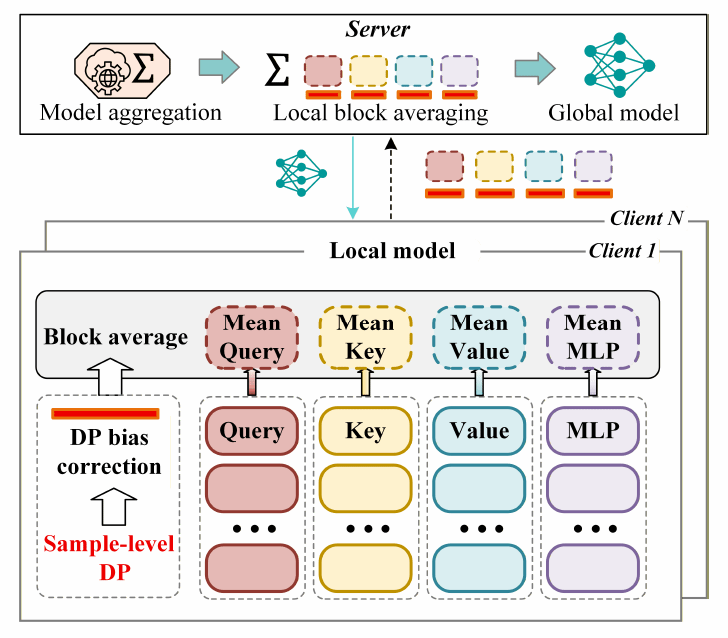

针对这些问题,我们提出DP-FedAdamW:通过块级二阶矩聚合稳定二阶矩方差并降低通信开销,通过无偏二阶矩校正消除DP噪声引入的系统性偏差,并通过本地-全局更新对齐将本地更新引导至全局下降方向,抑制客户端漂移,恢复AdamW在 DPFL下的训练效能。理论分析表明,DP-FedAdamW 可在非凸条件下实现收敛,并提供样本级DP隐私保证,无需假设客户端间梯度异质性。论文在视觉和语言任务上进行了大规模实验,覆盖多数据集、多模型架构、不同非IID数据分布以及不同DP设置。实验结果显示,DP-FedAdamW在强DP约束下优于SOTA方法。该工作已被CVPR 2026收录。

DP-FedAdamW架构示意图

这两项工作陆续入选国际顶级会议,代表着国际学术界同行对公司在人工智能安全领域科研实力的高度认可。同时,也标志着团队在相关前沿领域的重要突破,为推动大模型隐私保护技术的应用实践提供了有力支撑。